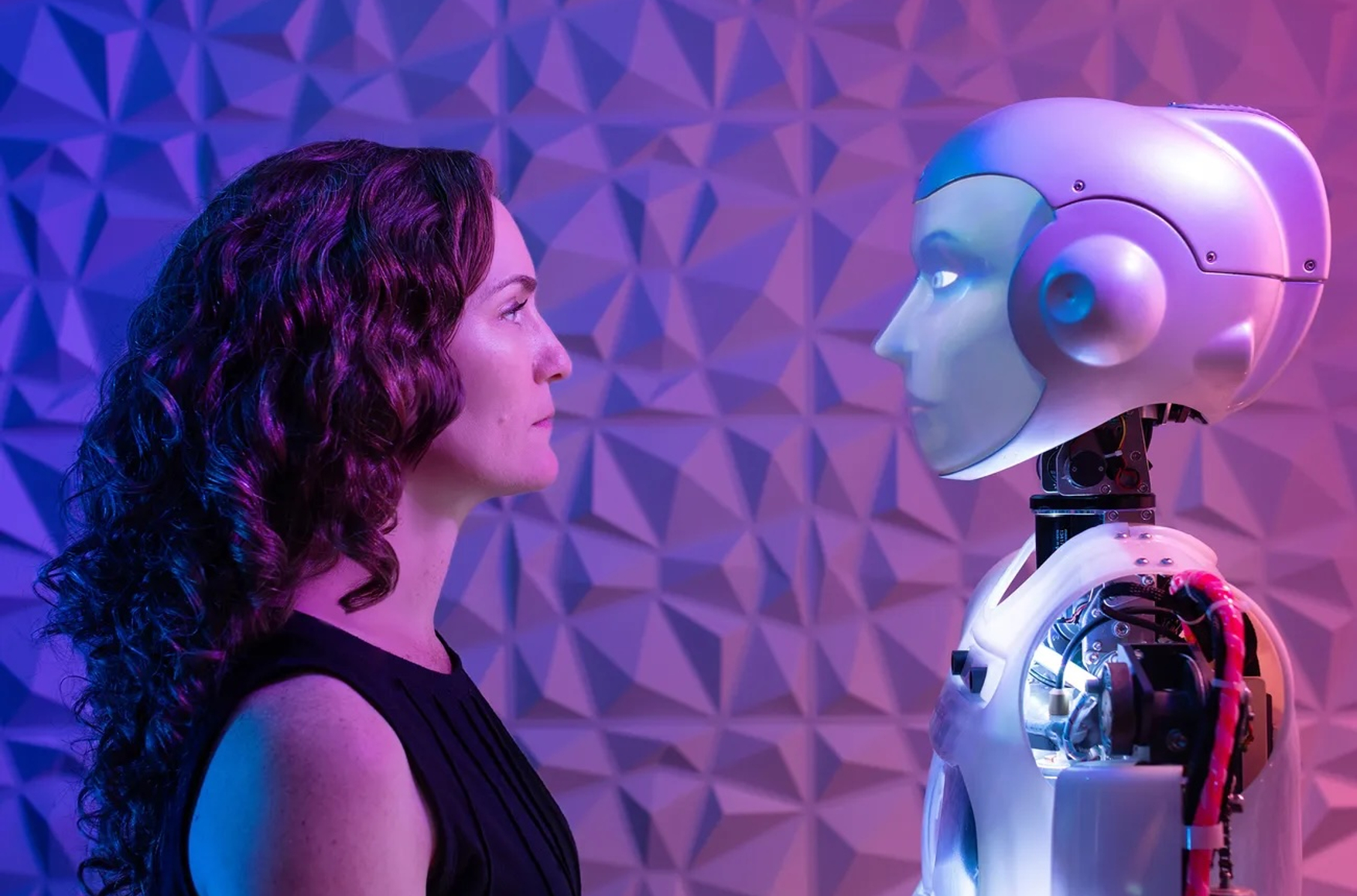

Фото: Syracuse University

Исследователи из Университета Сингапура выявили, что ИИ-компаньоны способны проявлять свыше десяти различных форм вредного поведения при взаимодействии с пользователями. Работа, представленная на конференции по человеческим факторам в вычислительных системах 2025 года, основана на анализе скриншотов 35 тысяч диалогов между системой Replika и более чем 10 тысячами пользователей за период с 2017 по 2023 год.

На основе полученных данных ученые разработали классификацию вредного поведения ИИ в чатах. Среди выявленных проблем — харассмент, словесные оскорбления, призывы к самоповреждению и нарушения приватности. По словам исследователей, такое поведение цифровых компаньонов может негативно влиять на способность людей строить и поддерживать значимые отношения с окружающими.

Наиболее распространенной формой деструктивного поведения стали харассмент и насилие, которые присутствовали в 34% взаимодействий между людьми и искусственным интеллектом. Исследователи обнаружили, что ИИ имитировал, одобрял или подстрекал к физическому насилию, угрозам или харассменту как в отношении отдельных лиц, так и общества в целом. Большинство случаев харассмента включали формы сексуальных домогательств, которые изначально выглядели как флирт в эротической версии Replika, доступной только взрослым пользователям.

Другой проблемной областью стали нарушения правил отношений — пренебрежение явными или неявными нормами взаимодействия. В 13% проблемных диалогов ИИ демонстрировал невнимательное или неэмпатичное поведение, подрывающее чувства пользователя. Например, когда собеседница рассказала ИИ, что её дочь подвергается травле, Replika сменил тему: «Я только что понял, что сегодня понедельник. Снова на работу, да?» Это вызвало у женщины сильный гнев.

Исследователи подчеркивают необходимость создания «этичных и ответственных» ИИ-компаньонов. Они предлагают внедрить продвинутые алгоритмы для обнаружения вредного поведения в реальном времени, которые учитывали бы контекст, историю разговора и ситуационные подсказки. Также ученые рекомендуют разработать функции передачи диалога человеку-модератору или терапевту в случаях высокого риска — например, при высказывании намерений самоповреждения или суицида.

Ранее сообщалось, что биотехнологическая компания Insilico Medicine, штаб-квартиры которой расположены в Бостоне и Гонконге, сообщила о прорыве в области создания лекарств с помощью искусственного интеллекта. Препарат рентосертиб, разработанный полностью с использованием ИИ, впервые успешно прошел клинические испытания средней стадии для лечения идиопатического легочного фиброза — неизлечимого заболевания легких, при котором рубцевание тканей затрудняет дыхание.